引言:不再只是"画得像",而是"想得明白"

过去一年,AI 图像生成领域似乎陷入了某种"精致疲劳"——模型产出的画面越来越华丽,但文字渲染依旧翻车、多语言支持形同虚设、复杂指令遵循时好时坏。直到 OpenAI 推出 ChatGPT Images 2.0,这一僵局才被彻底打破。

OpenAI 将此次发布定义为"下一步进化":一个能承担复杂视觉任务、生成精准且可直接使用视觉内容的最先进模型。与此前"你说我画"的被动渲染逻辑不同,Images 2.0 的核心变革在于引入了 O 系列模型的推理能力,让图像生成首次具备了"策略性设计"的特征。用山姆·奥特曼的话说,这种感觉"就像一下子从 GPT-3 跃升到了 GPT-5"。

像素级精度:终于能"看清字"的 AI

过往图像模型最大的通病之一,是面对小字号文本、UI 元素、图标和密集排版时几乎必然会失真。Images 2.0 将这一点变成了自己的杀手锏。

新模型能够精准渲染极小字号的文本,并妥善安排复杂版面中的层级关系。在官方演示中,模型甚至在一粒大米上刻出了"GPT image 2"的字样,展现了惊人的微观控制力。在 API 中,它最高支持 2K 分辨率输出,足以应对印刷级物料和精细界面设计的需求。

更值得关注的是,Images 2.0 对"非完美真实感"的把握。它不再一味追求过度光滑的 AI 美学,而是开始复现 35mm 胶片的颗粒感、一次性相机的过曝与动态模糊、甚至风中飘动的发丝和衣角。这种对"有意设计"而非"近似模仿"的理解,让输出结果真正具备了商业可用性。

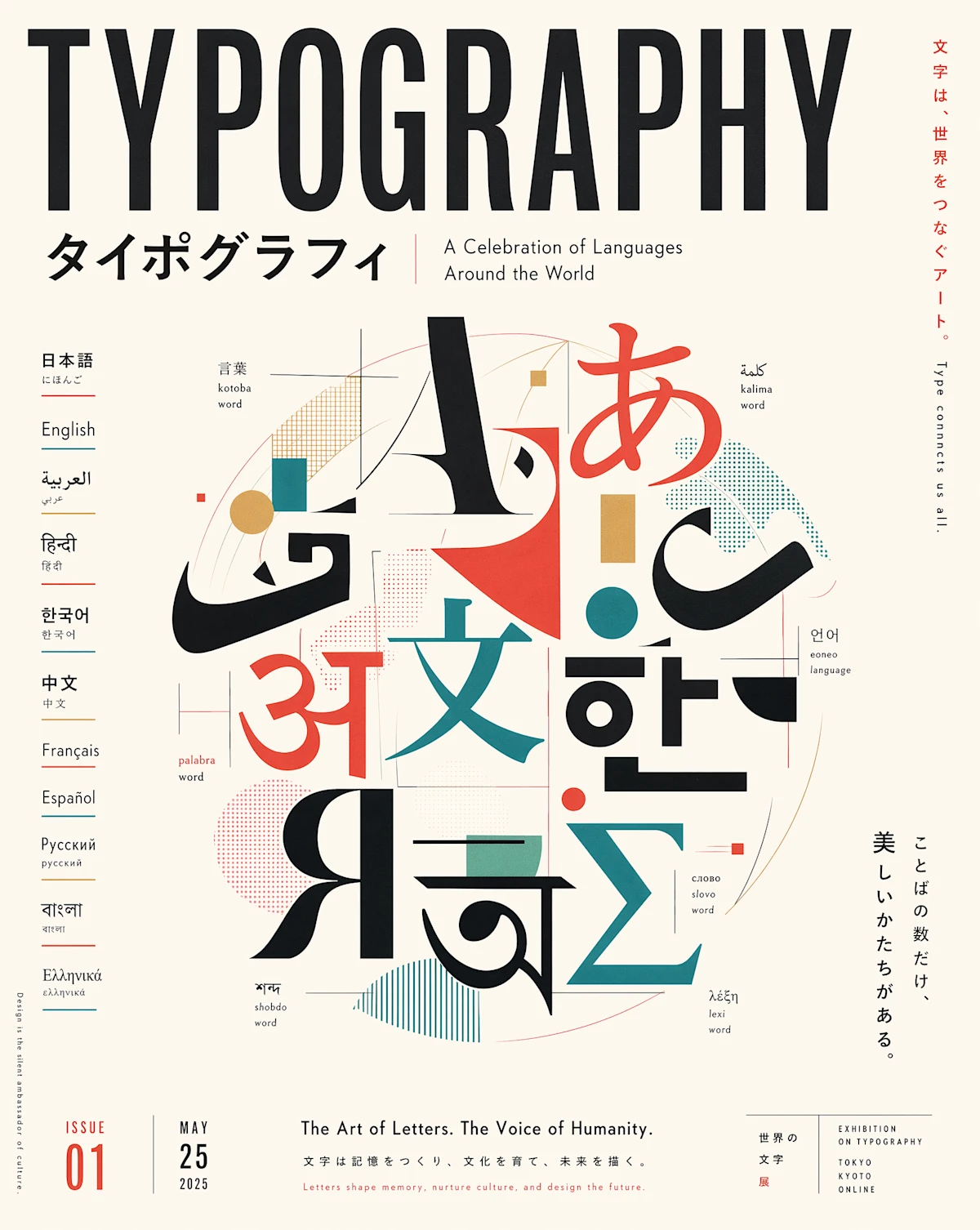

多语言飞跃:中文、日文、韩文精准输出

如果说像素级精度解决了"能不能用"的问题,那么多语言能力则决定了"谁能用"。

此前的图像模型在英语和拉丁字母体系下表现尚可,一旦涉及中文、日文、韩文、印地语或孟加拉语等复杂文字,往往会出现"鬼画符"式的乱码。Images 2.0 在这方面实现了质变:它不仅能正确拼写非拉丁字符,还能保证语句通顺、排版自然,让语言本身成为设计元素的一部分。

在官方发布直播中,OpenAI 研究科学家陈博远展示了一整页全中文彩色漫画,讲述团队优化中文文本渲染的故事。漫画中既有密集排版的信息图小字,也有"稳稳地接住你"这样的网络热梗自嘲——后者正是中文用户曾广泛吐槽的 GPT 经典话术。这种官方玩梗的背后,是对多语言场景深度理解的自信。

Thinking 模式:首个会"思考"的图像模型

Images 2.0 最颠覆性的升级,藏在"Thinking 模式"里。这是业界首次将 Agentic 推理能力系统性地融入图像生成流程。

在 Thinking 或 Pro 模式下,模型不再直接提笔作画,而是先经历一个内部的研究与规划阶段:解析 prompt 中的实体关系、构思画面布局、推理视觉层次,必要时还会联网搜索实时信息以补全知识。随后,它不仅能生成单张图像,还能根据一个提示词一次性产出最多 8 张风格统一、角色连贯、构图递进的多面板画面。

这意味着,从社交媒体多尺寸素材包到多页漫画分镜,从整屋设计方案到学术论文海报,用户无需逐张生成再手动拼接,一句 prompt 就能获得完整的工作流交付物。在这个过程中,Images 2.0 更像一位"视觉思考伙伴",承担了从概念到成品之间的大量中间工作。

全线落地:ChatGPT、Codex 与 API 同步开放

OpenAI 显然不打算让这项技术停留在演示阶段。发布当日,Images 2.0 即向所有 ChatGPT 和 Codex 用户开放,其中带有 Thinking 过程的高级输出面向 Plus、Pro 与 Business 订阅者。底层 gpt-image-2 模型也同步进入 API,支持开发者将其嵌入自有产品。

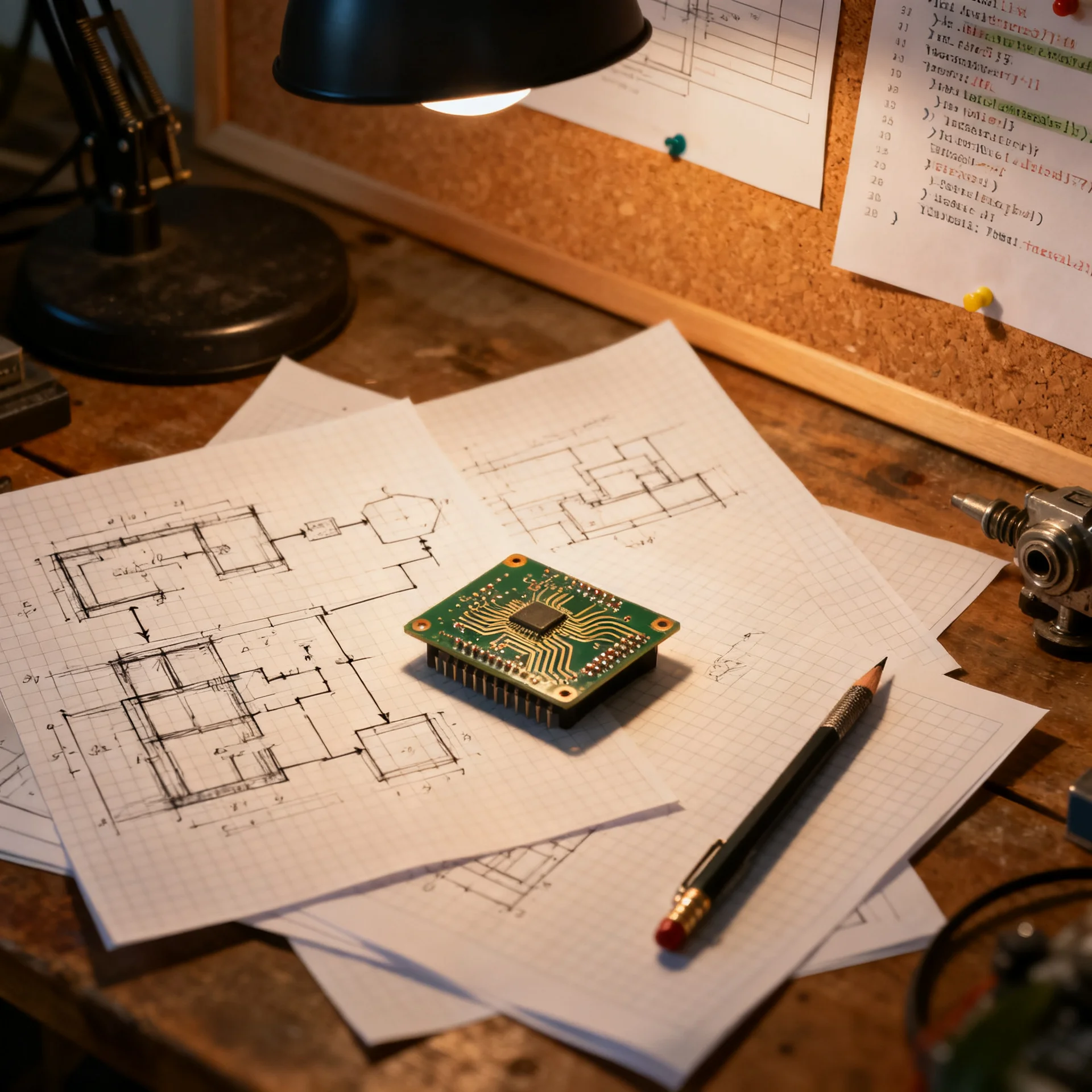

在 Codex 工作流中,图像生成与代码、设计、迭代被整合在同一空间内。设计师可以快速生成多种 UI 方向与原型,比较方案后直接将最佳设计转化为网页或产品体验,无需在不同工具间来回切换。

定价方面,gpt-image-2 延续了按 token 计费的逻辑,Image Output 价格相较前代略有下调。对于成本敏感场景,开发者仍可调用轻量版模型完成批量预览与草稿迭代。

竞技实测:Arena 三项第一,差距显著

在第三方评测平台 Image Arena 的盲测中,Images 2.0 发布前曾以"TapeDuck"为代号参与测试。正式亮相后,它以显著优势登顶三个核心榜单:文本转图像、单图编辑与多图编辑均位列第一,其中文生图类别领先第二名 242 分,被 Arena 评价为"迄今为止见过的最大差距"。

这一成绩不仅验证了 Images 2.0 在复杂指令遵循和一致性上的突破,也标志着 OpenAI 在视觉生成领域重新夺回了技术话语权。

局限与冷静思考:革命尚未完结

尽管 Images 2.0 能力飞跃,OpenAI 依然在官方博客中坦诚列出了模型的局限:对于需要完整物理世界建模的任务(如折纸教程、魔方等复杂结构),以及隐藏面、倾斜面或反向表面的精确细节,模型仍可能表现不足;极高密度或重复性细节(如细沙)同样具有挑战性;涉及精确箭头或部件标注的图示,仍建议人工校对。

此外,超过 2K 的超高分辨率输出目前处于测试阶段,可能出现不稳定情况。这些边界提醒我们:Images 2.0 已经跨过了"玩具"阶段,但在高精度工业设计和严谨科学可视化领域,人机协作仍是必要路径。

结语:图像生成的"iPhone 时刻"来了吗?

从 DALL·E 到 Midjourney,再到如今的 ChatGPT Images 2.0,AI 图像生成走过了一条从"惊艳"到"实用"的漫漫长路。Images 2.0 的独特价值,不在于它能在某项单一指标上碾压对手,而在于它第一次将"推理""多语言""像素级控制"和"工作流整合"打包成了可落地的生产力工具。

当设计师可以用一句 prompt 拿到一组风格统一、文字无误、可直接上架的跨境电商海报;当内容创作者不再需要为了一张信息图在 Photoshop 和翻译软件之间反复横跳——我们或许正在见证 AI 图像生成从"创意辅助"走向"生产基础设施"的关键转折。

当然,技术的狂飙突进始终伴随着关于创作者权益与职业替代的社会讨论。对 OpenAI 而言,如何让人们真正信任并驾驭这项能力,或许比让它生成一粒刻字的大米更加困难。

模型低价使用

还在为模型选型与接入调试而烦恼?LinkThinkAI 为您提供一站式解决方案。

我们现已全面支持 DeepSeek-V4、GPT-5.5 及 GPT-Image-2 等前沿模型。通过我们统一对齐 OpenAI 风格的 API,您只需更改 Base URL 即可快速切换与上线,极大降低了集成与迁移成本。

现在注册,通过本平台调用 GPT 系列模型,可享独家 7.5 折优惠,助您以更低的成本体验顶级模型能力。

我们的平台为您整合了多家供应商与多模态能力,提供:

- 灵活路由:支持通道、分组与回退策略配置,保障服务高可用。

- 成本清晰:通过模型倍率、用量统计与分组策略,让预算与账单一目了然。

- 简单接入:从创建账号到首次成功调用,步骤清晰简单。

告别繁琐的逐个对接,用一份文档、一个密钥管理所有模型。立即访问 https://linkthinkai.com ,开启高效、稳定、高性价比的模型调用之旅。