核心功能

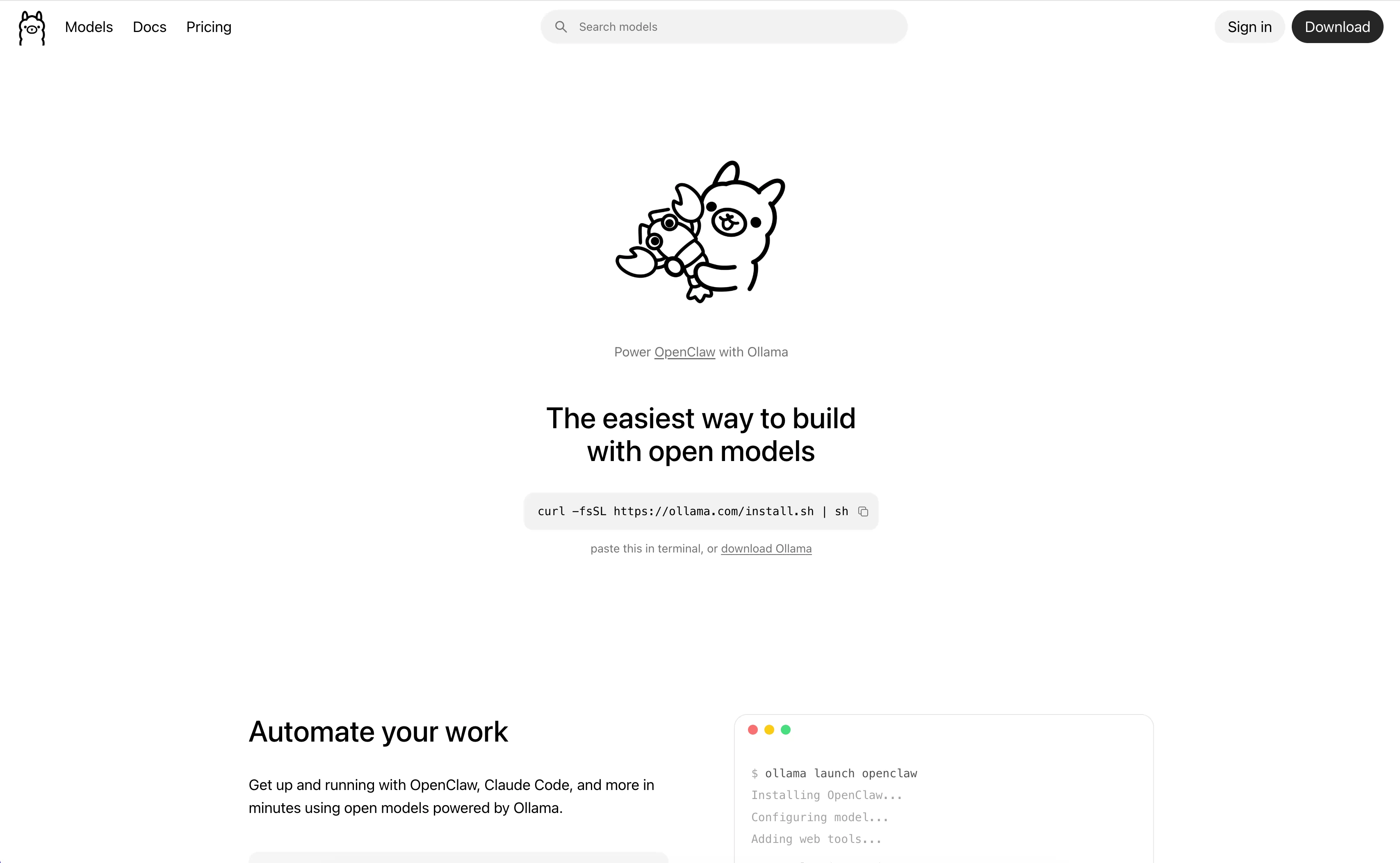

Ollama 是一个专为在本地机器上便捷部署和运行大型语言模型(LLM)而设计的开源工具。它通过简单的命令行界面,让用户能够轻松地在本地环境中运行各种开源大模型。

主要特点

- 一键部署:通过简单的安装脚本即可快速部署,支持多种操作系统

- 模型管理:内置模型库,支持 Llama、Gemma、Qwen、Mistral 等主流开源模型

- 本地运行:所有模型和数据都在本地运行,确保数据隐私和安全

- Modelfile 配置:使用

Modelfile文件定义模型配置,支持自定义模型参数 - REST API:提供标准的 API 接口,方便与其他应用集成

适用场景

- 开发者测试:在本地环境中快速测试和调试大模型应用

- 隐私敏感项目:处理敏感数据时需要在本地运行模型

- 离线环境:在没有网络连接的环境中运行 AI 模型

- 教育研究:学习和研究大模型技术的理想工具

主要优势

数据安全:所有模型和数据都在本地运行,无需上传到云端,确保数据隐私。

简单易用:通过 ollama run <model> 等简单命令即可运行模型,无需复杂配置。

资源优化:支持模型量化,可以在有限的硬件资源上运行大模型。

社区支持:拥有活跃的开源社区,持续更新和维护,支持多种主流开源模型。

跨平台:支持 macOS、Linux 和 Windows 系统,满足不同用户需求。